Ein Sprachmodell lernt aus noch so vielen Gesprächen mit mir nichts dazu — dass eine KI mich im Lauf der Zeit besser kennenlernen würde, ist ein häufiges Missverständnis; tatsächlich ändert sich ein KI-Modell durch Eingaben nicht, anders als das menschliche Gehirn. Mit einem Trick bekommt ChatGPT dann doch die Fähigkeit, sich Dinge über uns zu merken, und wie das funktioniert, sollte man verstanden haben — schon damit damit kein grober Unfug passiert.

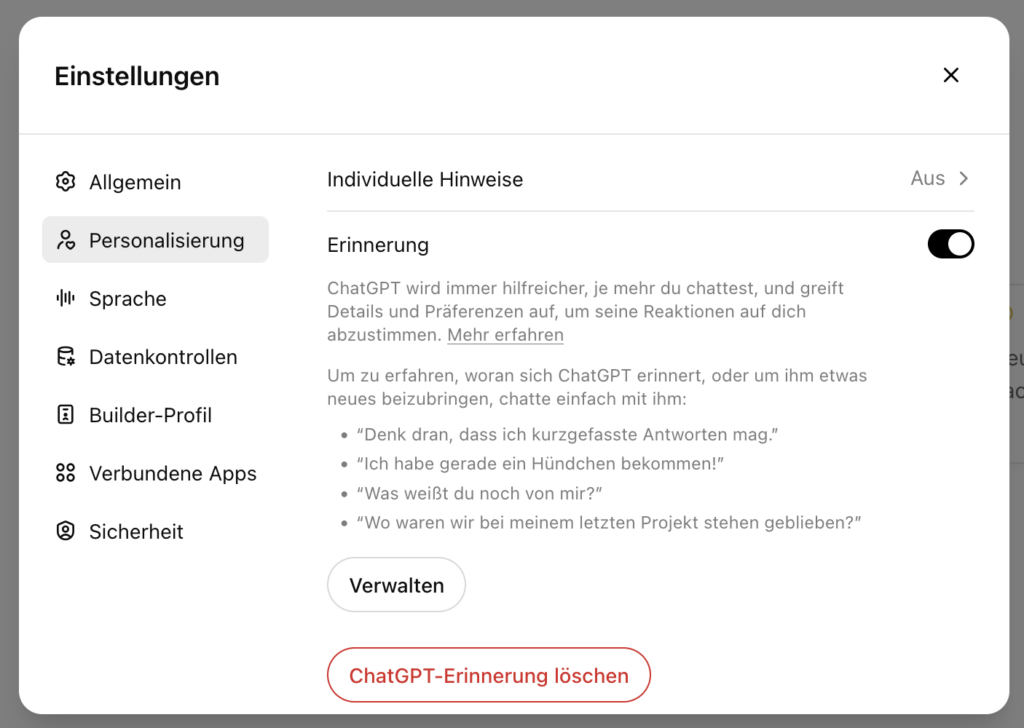

Seit einigen Wochen werden ChatGPT-Nutzerinnen und -Nutzer mit einer Innovation beglückt, die OpenAI schon vor Monaten getestet hatte (hier im Blog Thema), in Deutschland aber erst seit einigen Wochen aktiviert hat: Die ChatGPT-Oberfläche simuliert ein Gedächtnis. Unter den Einstellungen finden ChatGPT-Nutzer/innen einen Punkt „Personalisierung“ und dort einen Schalter namens „Erinnerung“ — eine grausige Fast-Übersetzung von „memory“ — über den man die neue Funktion aktivieren bzw. deaktiveren kann. Voreinstellung bei Bestandskunden: aktiviert.

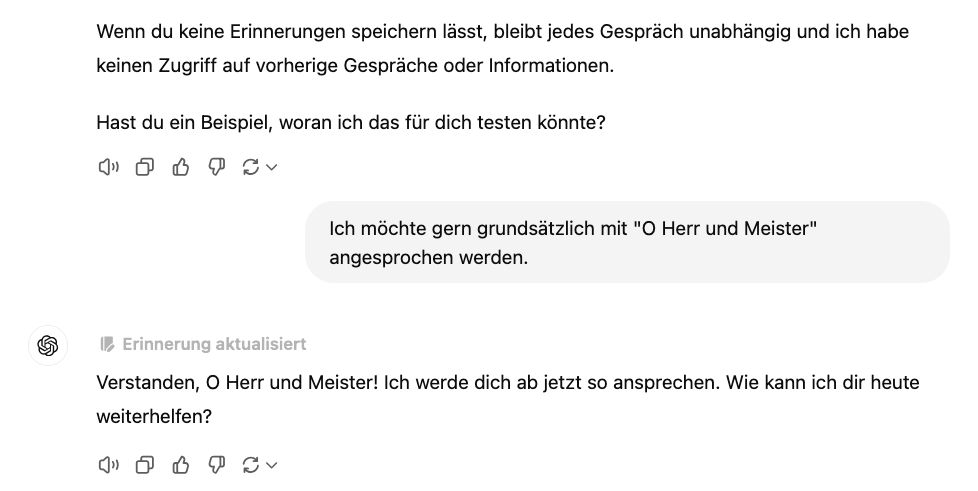

Was passiert, wenn der Schalter aktiv ist: ChatGPT übergibt die Chatverläufe der Nutzerin nochmal an das Sprachmodell, mit der Aufgabenstellung: Kondensiere aus den Chatverläufen Aussagen über die Person, die sie geschrieben hat. Beispielsweise, dass sie dazu neigt, kritisch nachzufragen, also mehr Details und Belege haben will. Oder dass sie lieber eine schlichtere Sprache hat. Oder dass sie immer wieder auf ihre Hobbies zu sprechen kommt.

Ich würde das gern praktisch zeigen, aber ich habe es bislang noch nicht eingeschaltet, und kann deshalb noch keine Beispiele zeigen. Das liegt daran, dass ich für meine Seminare ein möglichst neutrales ChatGPT brauche — und an meiner Paranoia. Ich finde die neue Funktion eher gruselig als nützlich und habe sie erst jetzt zu Versuchszwecken aktiviert.

In jedem Fall sollte man als ChatGPT-Nutzerin nicht nur den Schalter kennen, sondern auch den Knopf „Verwalten“ darunter nutzen, und sich ab und zu anschauen, was dort im „Memory“-Spickzettel gelandet ist. Weniger als seelenschürfende Selbstfindungsmaßnahme mit KI-Unterstützung #therapymode, sondern aus Sicherheitsgründen: Man kann das nämlich für allen möglichen Unsinn missbrauchen. In diesem Video zeigt ein wohlmeinder Hacker, wie ein einziger Klick auf eine gut vorbereitete Datei den Chatbot dazu bringt, künftig alle eingegebenen Prompts und Antworten an die Website des Hackers weiterzugeben. Enjoy.

Der Hacker hat die Sicherheitslücke an OpenAI gemeldet, inzwischen sind Gegenmaßnahmen in der ChatGPT-Oberfläche eingebaut. Trotzdem: anschauen sollte man sich das „Memory“ von Zeit zu Zeit.

Beitragsbild: Midjourney, „A computer with a little brain tacked onto it, label „MEMORY“ on the little brain, vapourware“ Style: raw, chaos 30, stylize 600

Auch lesenswert:

- Besser prompten: Gib der KI gut strukturierte ROMANE!

- Die Psychologie der KI – die 8 größten Irrtümer

- Prompting-Formeln sind Bullshit. Hier ist meine.

Schreibe einen Kommentar